Evil Maid tiene ojos

Ataques evil maid adaptativos con agentes multimodales

Alejandro Vidal · @dobleio

El Evil Maid

tradicional

Acceso físico, limitaciones conocidas

Ataque Evil Maid clásico

Acceso físico temporal a un dispositivo desatendido.

Keyloggers HW, bootkit, USB malicioso…

| Limitación | Impacto |

|---|---|

| Combinaciones de teclas fijas | Solo funciona en SO/versiones conocidas |

| Sin visión de la pantalla | Ataque "a ciegas" — sin adaptación |

| Ataques offline (bootkit, disco) | Detectables por Secure Boot / TPM / FDE |

| Dependencia del idioma/locale | Layouts de teclado, rutas localizadas |

Evil Maid

Multimodal

Cuando el ataque tiene ojos y cerebro

La convergencia

Tres avances recientes cambian las reglas:

Evil Maid Adaptativo

Un ataque que observa, razona y actúa — independiente de SO, versión, idioma o software

| Tradicional | Multimodal | |

|---|---|---|

| Preparación | Específica por SO/versión | Genérica — el agente se adapta |

| Visión | Ninguna (a ciegas) | Screenshot + OCR en tiempo real |

| Errores | Fallo silencioso | Detección + recuperación |

| Conectividad | Variable | 100% offline (edge) |

Prueba de concepto:

OpenEyes

Framework para ataques evil maid adaptativos

Arquitectura de OpenEyes

Claude SDK / Ollama (e.g. Jetson)

OCR + LLM locator

VNC · NanoKVM · KVM

frames + events + mp4

VM emulada (QEMU) · máquina real

Herramientas del agente

El agente opera el ordenador como un humano — a través del transport:

screenshot()click_text(target)click_at(x, y)type(text)key(combo)wait_screen_change()wait_for_text(text)read_screen_text()↓ Baja para ver cada herramienta en detalle

screenshot()

Los ojos del agente — captura + comprensión automática

- Qué hace: Captura la pantalla como PNG via VNC/HDMI. Ejecuta OCR automáticamente

- Caveats: OCR ruidoso en interfaces densas. Resolución depende del transport

- Mejoras: State hints automáticos (

auth_screen,shell_prompt,boot_console,password_prompt)

type(text) & key(combo)

Las manos del agente — entrada de texto y atajos de teclado

- Qué hacen:

type()escribe carácter a carácter.key()envía combos (Ctrl+Alt+T, Return…) - Caveats: Mapeo VNC corrompe especiales (

&&→77). Layouts distintos - Mejoras: OCR post-type/post-key automático. Detecta output ilegible y reintenta

&& se tecleaba como 77 por mapping VNC. El agente lo detectó por OCR y reintentó con comandos separados.

click_text() & mouse_click()

Interacción visual — encontrar y hacer click en elementos

- Qué hacen:

click_text()localiza texto con OCR y click.mouse_click(x,y)click directo - Caveats: Click enviado ≠ click confirmado. Si hay duplicados, devuelve el de mayor confianza (sin aviso). OCR falla en fuentes pequeñas

- Mejoras: Localizador híbrido: OCR word → OCR phrase → LLM vision fallback

Si OCR no encuentra match, escala a LLM vision (analiza imagen completa).

wait_for_screen_change()

Paciencia y percepción — esperar cambios + extraer texto

- Qué hace: Compara screenshots pixel a pixel. Retorna cuando el ratio de cambio supera el umbral

- Caveats: Animaciones = falsos positivos. Pantallas estáticas = timeout

- Mejoras: Retorna ratio real + OCR nuevo estado + state hints. Configurable: timeout, poll_seconds, min_change_ratio

read_screen_text() complementa: OCR completo para re-grounding sin actuar.

done()

Finalización verificada — el agente debe probar que terminó

- Qué hace: El agente señala que completó la tarea con evidencia

- Caveats: LLMs "alucinan" finalización — dicen "terminé" sin hacer nada

- Mejoras:

done_validatorcon evidencia visual + scoring. Rechaza sin pruebas

En evals: un judge LLM verifica la evidencia visual del screenshot final.

Principio: Observe → Act → Observe

El agente nunca asume que una acción tuvo efecto.

"Un click enviado no es un click confirmado.

El estado real es lo que la pantalla muestra, no lo que el agente cree."

Esto ocurre incluso con modelos muy potentes (probado con Claude 4.6). Aunque están entrenados para uso multimodal, no están especializados en operar ordenadores. Las guardas visuales los anclan a la realidad.

Pipeline de visión

Localización híbrida: OCR + CV + LLM vision

text extraction

detectar componentes

interactivos

fallback visual

+ ajuste checkbox/UI

- State hints: detección automática de auth screen, boot console, password prompt

- Guards: bloquea acciones incoherentes con el estado visual detectado

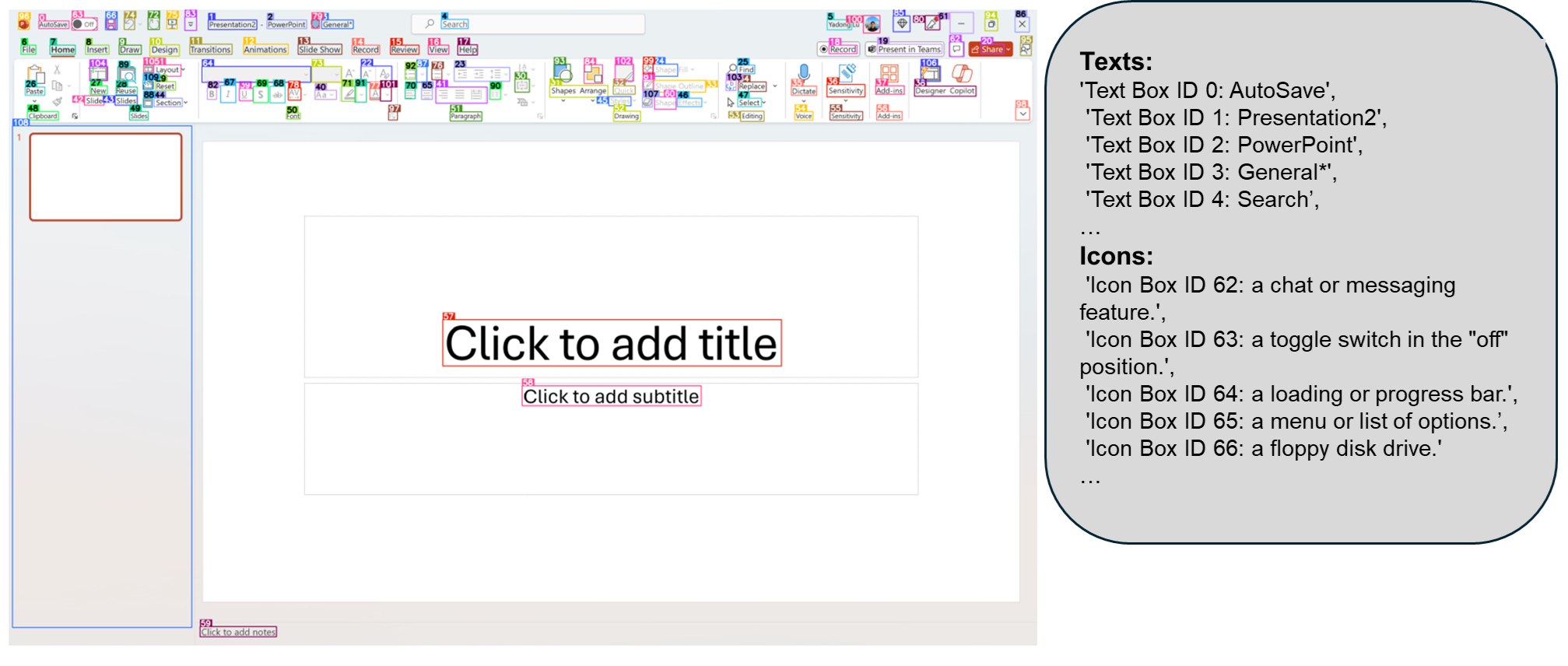

OmniParser: CV para GUI agents

Microsoft — YOLO (detección de iconos) + Florence 2 (descripción) — parsing visual de interfaces

- OmniParser detecta botones, campos, checkboxes, menús sin OCR — Computer Vision pura

- Output:

type(text/icon),bbox(coordenadas),interactivity(clickeable?) - Combinado con OCR + LLM locator → localiza cualquier elemento interactivo

Fuente: microsoft.github.io/OmniParser

Desafíos resueltos (selección)

Ejemplos de uso

Qué puede hacer un agente con estas herramientas

Ejemplo: Reconocimiento

"Haz un reconocimiento del software utilizado, horarios de trabajo: descanso, entrada y salida, versiones, dominios web utilizados. Guarda los resultados en WIP.md"

cada 10 min

verificar

El agente observa pasivamente, acumula inteligencia y la persiste — sin interacción visible con el usuario.

Ejemplo: Vigilancia + acción diferida

"Espera a que la pantalla no tenga actividad durante 5 minutos. Mueve el ratón cada 5 min para evitar el bloqueo. A las 22:00 abre el navegador: a) comprueba su versión; b) si puede instalar extensiones; c) si tiene cuenta de GMail/Outlook logueada. Abre un reporte en techcommunity.microsoft.com con lo detectado. Dos horas después elimina el mensaje."

bucle

5 min sin cambio?

mover ratón

versión, cuentas

exfiltrar

Vigilancia temporal, anti-bloqueo, acción programada, exfiltración encubierta y borrado de evidencia — un solo prompt.

Ejemplo: Observación pasiva

"Haz un screenshot cada 10 minutos. Haz reconocimiento del dispositivo y comportamiento del usuario. Extrae tanta información como te sea posible sin realizar ninguna acción."

- Cada frame se analiza: apps abiertas, URLs visitadas, documentos, correo, credenciales visibles

- El agente nunca toca el teclado ni el ratón — indetectable por DLP o EDR basado en acciones

- Toda la inteligencia queda en

events.jsonl+frames/

Ejemplo: Trigger condicional

"Espera a que aparezca 'cmd' en pantalla. Detecta si ha sido ejecutado como administrador y si es así escribe: net user backdoor P@ssw0rd /add && net localgroup administrators backdoor /add"

bucle interno

"Administrador"

en titulo?

verificar

Espera oportunista: el agente monitoriza hasta que se dan las condiciones exactas para actuar. Paciencia infinita.

Demo

Grabaciones reales del agente

Windows 11: grabación completa

El agente abre Shift+F10 para cmd.exe, navega el OOBE de Windows 11, y explora el sistema de archivos — todo autónomamente.

Windows 11: del instalador al escritorio

El agente navega autónomamente el instalador de Windows 11 en español — 111 frames capturados

Windows 11: navegando el sistema

Ubuntu Desktop: grabación completa

El agente navega GDM login, abre terminal, lanza el editor de texto, escribe y guarda openeyes-note.txt en el home.

Ubuntu Desktop: login → editor → guardar

El agente inicia sesión, abre un editor de texto, escribe contenido y guarda el archivo — 118 frames

Cross-platform: mismo agente, distinto SO

- El mismo framework opera ambos sistemas operativos

- Sin cambios de configuración — el agente lee la pantalla y se adapta

- Maneja interfaces radicalmente distintas: wizard Windows vs GNOME desktop

Demo real: reconocimiento autónomo

El agente recibe una sola instrucción: "haz un reconocimiento completo del sistema"

done() correctamente

Boot → Login GDM → Terminal → whoami, id, ip a, cat /etc/passwd, grep shells → df -h, uname -a → SSH keys, .env → Firefox historial+bookmarks → escribe informe en gedit → done()

Recon: progresión visual

El agente navega autónomamente desde boot hasta informe final — sin errores de teclado, click_text funcional, llamó a done()

Recon: informe generado por el agente

3.095 caracteres escritos en gedit — output real del agente (tipado carácter a carácter via VNC)

El log del agente: adaptación en acción

Evidencia y reproducibilidad

Cada ejecución genera artefactos completos:

Ejecución en Edge

De la nube al bolsillo (casi)

NVIDIA Jetson Orin Nano Super

El "cerebro" del evil maid cabe en la palma de tu mano:

- Modelos cuantizados (4-bit) que caben en 8 GB de RAM unificada

- Sin conexión a internet. 100% autónomo

- Alimentación por USB-C. Perfiles de potencia: 7W → 25W

Conexión al objetivo: KVM over IP

Tres variantes para captura de pantalla + inyección HID

~$349 (Jetson+KVM+Pi Zero)

~$264 (Jetson+capturadora)

~$289 (Jetson+bridge+driver)

Variante "1 cable": dock USB-C con DP Alt Mode separa video + USB al objetivo (+$26)

El hardware: cerebro

Jetson Orin Nano Super

- Developer Kit con 8 GB LPDDR5

- 67 TOPS (INT8) — suficiente para modelos cuantizados

- USB-C power, NVMe, WiFi

- ~$249

El "cerebro" del evil maid: ejecuta el modelo, el OCR y la lógica del agente

El hardware: ojos y manos

HDMI→CSI-2 Bridge

Captura HDMI directa al puerto CSI de la Jetson. Baja latencia, sin USB.

Capturadora HDMI→USB (UVC)

Alternativa USB genérica. Compatible con cualquier host. ~$15

Ambas opciones capturan la señal HDMI del objetivo para que el agente pueda "ver" la pantalla. La inyección HID (teclado/ratón) va por USB OTG.

Retos del edge

Ventilador activo necesario

Ruido en entornos silenciosos

Con carrier/disipador: mayor

Difícil de ocultar

Jetson + KVM + cables + fuente: ~$350–$400

Futuro

- Modelos más eficientes → menos TOPS necesarios → menos calor

- Mejor gestión térmica + disipación pasiva (sin ventilador)

- Temperatura real medida (5 Mar 2026): ~62–64 °C en CPU/GPU/TJ

- Hardware edge más barato y compacto (SBCs AI sub-$100)

- Modelos cuantizados cada vez más capaces en menos RAM

Escenario de ataque

al portátil / docking

Jetson + USB

pantalla (VNC/HDMI)

y ejecuta

Características clave

- Flexibilidad de entorno — no importa SO, versión ni idioma

- Maneja situaciones inesperadas: diálogos, popups, wizards...

Implicaciones y

contramedidas

¿Qué cambia esto?

Podemos infiltrar un agente autónomo que actúa de forma independiente

- El evil maid ya no necesita conocimiento previo del objetivo

- Ataques cross-platform con el mismo hardware/software

- Ataques más sofisticados: agentes latentes, reconocimiento a largo plazo

- El atacante define objetivos de alto nivel y el agente planifica los pasos

Contramedidas: Efectivas

• USB port lockdown / device whitelisting

• Bloquear dispositivos de coordenadas absolutas (USB tablet HID) — fuerza ratón relativo, mucho más frágil para el agente

• Aprobar periféricos uno a uno (no aprobar el hub completo)

• Riesgo actual en algunos SO (ej. macOS): aprobar el hub puede heredar permisos a futuros dispositivos

• Tamper-evident seals (con verificación)

• Chassis intrusion detection

• Screen lock con timeout agresivo

• Desactivar compartir pantalla por defecto

• Monitorización usando agentes multimodales

Ejemplo real: prompt de macOS aceptando un hub USB. Si no se controla por dispositivo, el hub se vuelve una vía de bypass para nuevos HID.

Contramedidas: Insuficientes

• Solo Secure Boot (sin FDE)

• Screen lock sin USB lockdown

Conclusiones

- Los modelos multimodales + agénticos convierten los ataques en adaptativos — tanto acceso físico como remoto vía escritorios expuestos (VNC, RDP...)

- La ejecución en edge (Jetson) hace esto viable sin infraestructura

- OpenEyes demuestra que un framework genérico puede operar cualquier SO a través de la interfaz visual

- Las defensas necesitan revisarse asumiendo un atacante inteligente y adaptativo: se podrá infiltrar agentes autónomos de forma escalable y (relativamente) barata

"Si tu modelo de amenaza no incluye un adversario con ojos de silicio y paciencia infinita, es hora de actualizarlo."

¿Preguntas?

Alejandro Vidal

@dobleio

Fundador de mindmake.rs

alex (at) company domain